【今すぐ実践】Gemini のハルシネーション対策に必要なプロンプトと検証方法

コラム更新日:2026.02.13

生成 AI は目覚ましい進化を続けており 、 Google の生成 AI Gemini はその中心的な役割を担うことが期待されています。 しかし、多くの企業において AI 活用の懸念材料となっているのが、AI がもっともらしい嘘をつくハルシネーション 問題です。

ですが、「AIの回答が信じられないなら、業務には使えない」と判断するのは時期尚早です。ハルシネーションは、その発生メカニズムを理解し、適切なプロンプト(指示文)と運用ルールを組み合わせることで、実務上問題のないレベルまでリスクを制御できます。

本記事では、Gemini のハルシネーション対策に特化し、今日から使える具体的なプロンプト術や、組織として安全に AI を使いこなすための体制構築について解説します。

執筆・監修:TSクラウド編集部

Google Cloud の「プレミア認定」を保有する、Google Workspace 正規販売代理店です。業界歴 17 年、延べ 3,500 社以上の導入支援実績( 2026 年 2 月時点)に基づき、Google Workspace の最新機能から活用術、DX推進に役立つノウハウを専門的な視点で解説しています。

※情報は記事公開(更新)時のものです。Google Workspace の仕様や価格は変更される場合があるため、最新情報は必ず公式ページでご確認ください。

目次

▼生成 AI 活用・業務効率化は、Google Workspace ・Gemini の導入がおすすめです!

Google 認定プレミアパートナーである TS クラウドに、Google Workspace ・Gemini 導入について相談してみませんか。

Gemini のハルシネーションとは?

ハルシネーションとは、AI が事実に基づかない情報を、あたかも真実であるかのように、もっともらしい文章で生成してしまう現象を指します。たとえば、実在しない法律の条文を引用したり、存在しない過去のニュースを詳細に語ったり、架空の製品スペックを提示したりするケースがハルシネーションに該当します。

Gemini はとても高度な言語モデルですが、あくまで言葉の並びを予測するプログラムであり、現段階では人間のように真実を理解して話しているわけではないことを利用者が認識する必要があります。

ビジネスシーンにおいて、このハルシネーションを放置することは、誤ったデータに基づく意思決定や、信頼喪失を招くリスクがあります。Gemini をビジネス活用する上では、ハルシネーションの発生をいかに抑制するかという視点が不可欠です。

ハルシネーションが発生してしまう理由

なぜ、最高峰の技術を誇る Gemini であってもハルシネーションが発生してしまうのでしょうか。その理由は、AI の設計思想と情報の処理プロセスに深く関わっています。 ハルシネーションを引き起こす AI の仕組みや性質 について解説します。

単語のつながりを「確率」で予想し文章を生成する仕組み

Gemini を含む大規模言語モデル(LLM)の本質は、「次に来る可能性が最も高い単語」を統計的な確率に基づいて選んでいることにあります。

AI は膨大なテキストデータを学習しており、たとえば「我思う、故に」という言葉の次には「我あり」という単語が来る確率が高いことを知っています。しかし、これは論理的に正しいから選んでいるのではなく、過去のデータでそのように並んでいたことが多いから選んでいるに過ぎません。

この仕組みにより、AI は文法的・文脈的には自然な文章を作成しますが、内容が事実に即しているかどうかを検証する自意識や、倫理観を持っていない ため、確率的にもっともらしい嘘が生成されてしまうことがあります。

学習データにないことでも補完しようとする性質

AI には、ユーザーからの問いかけに対して「何かを答えようとする」強い性質があります。これを補完機能 と呼びますが、これが裏目に出るのが、学習データに存在しない未知の情報や、専門性が高すぎる内容を問われた時です。

AI は「分かりません」と答えるよりも、学習済みの断片的な情報を無理やりつなぎ合わせ、欠落した部分を想像で埋めて回答を完成させようとします。この親切心とも取れる振る舞いが、もっともらしい嘘「ハルシネーション」の原因となります。

Gemini 独自の機能「グラウンディング」と限界

Gemini の強みは、Google 検索と連携して最新情報を取得する「グラウンディング」という機能にあります。これにより、従来の AI が苦手としていた最新ニュースや株価、天気などの情報についても、一定の信頼性を保った回答が可能になりました。

しかし、グラウンディングも万能ではありません。

- 検索結果のソース自体に誤りがある場合

- 検索された膨大な情報から、AI が重要な箇所を見落としたり、解釈を誤ったりした場合

- 指示が曖昧で、AI がどの情報を優先すべきか判断を誤った場合

上記のようなケースでは、検索機能を利用しているにもかかわらず、ハルシネーションが発生してしまいます。Google が作っているから安心と過信せず、常に検証が必要な理由がここにあります。

【実践】ハルシネーションを抑制するプロンプト術

ハルシネーションのリスクを最小限に抑える鍵は、AI への指示出しであるプロンプトの工夫 にあります。以下の 4 つのテクニックを意識するだけで、回答の精度は劇的に向上します。

① 役割と文脈を明示する

AI に対して「あなたは誰で、どのような目的でこの仕事をしているのか」 という文脈(コンテキスト)を具体的に与えます。

【プロンプト例】

「あなたは企業の DX 推進を支援するプロの IT コンサルタントです。Gemini の導入を検討している企業のマネージャー層に向けて、実務で使えるハルシネーション対策を 3 つ、専門用語を避けて分かりやすく解説してください。」

たとえば「ハルシネーションの対策について教えて」といきなり AI に指示した場合と比較し、上記のように、役割を定義し目的を明確にすることで、AI が参照すべき学習データの範囲が絞り込まれ、一貫性のない的外れな回答を抑止する効果があります。

② 「わからない場合は回答しない」と指示する

AI の無理をしてでも答えようとする性質を逆手に取った対策です。プロンプトの最後に、以下のような制約を付け加えます。

【プロンプト例】

- 提供された情報の中に根拠がない場合は、決して推測で答えず「不明です」 と回答してください。

- 事実に基づいた情報のみを記述してください。不確かな場合は、その旨を明記してください。

この一文を加えるだけで、AI は「嘘をつくことのリスク」を認識し、ハルシネーションの発生を大幅に減らすことができます。

③ 思考のプロセスを書き出させる

これは「Chain of Thought(思考の連鎖)」と呼ばれる手法です。結論だけを求めるのではなく、結論に至るまでの考え方を順序立てて説明させます。

【プロンプト例】

「この市場調査データに基づいて、来期の戦略を提案してください。まず、現在の市場の課題を 3 つ抽出した上で、それぞれの課題に対する解決策を検討し、最後にそれらを統合した結論を導き出してください。ステップバイステップで考えてください。」

プロセスを言語化させることで、AI 自身の内部で論理的な矛盾に気づきやすくなり、飛躍した嘘を防ぐことができます。

④ Google 検索機能(グラウンディング)を明示的に使う

Gemini の最大の武器である検索機能を最大限に活かします。

【プロンプト例】

「最新の Google 検索結果をもとに、2026年現在の日本における生成 AI 活用の最新事例を 3 つ紹介してください。各事例について、参照した URL もあわせて提示してください。」

このように、情報のソースを明示させ、かつ検索結果に基づくことを強要することで、AI が学習データのみに頼って適当な回答を作ることを防ぎます。

生成された回答は「検証」が重要。Gemini での 3 つの確認方法

プロンプトをどれだけ磨いても、ハルシネーションのリスクは依然として残ります。ビジネス活用においては、AI の回答をそのまま信じないという検証プロセスの確立 が必須です。

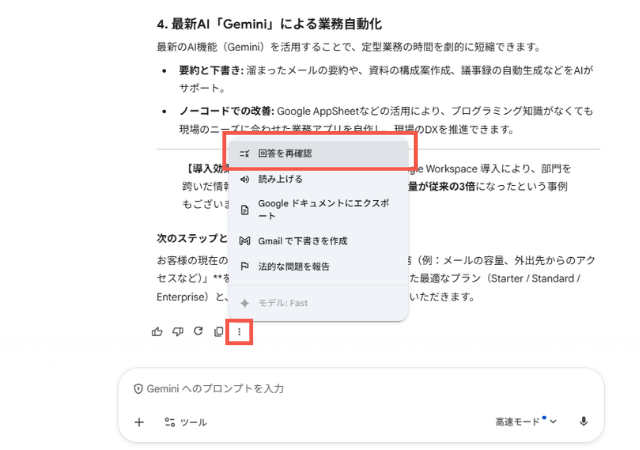

回答の再確認(ダブルチェック機能)の活用

Gemini には、生成された回答の信憑性を確認する「回答を再確認」機能 が備わっています。

【 利用方法 】

生成された回答の下部にある「⋮」ボタンをクリックします。(スマートフォン画面の場合、表示が異なる場合があります。)

表示された選択肢の中から「回答を再確認」を選択し、クリックします。

これにより、回答内容がWeb 上の情報と一致しているかどうかが自動で評価されます。

- 緑色のハイライト: Google 検索の結果と類似した内容が見つかった箇所。

- 茶色のハイライト: Google 検索の結果と異なる可能性が高い、あるいは情報が見つからなかった箇所。

この機能を活用すれば、どの部分を疑うべきかが一目でわかり、効率的なファクトチェックが可能になります。

ソース(出典)の事実確認

AI が回答の中で URL や文献を提示した場合、必ずそのリンク先をクリックし、実際に存在するか、かつ内容が正しいかを確認してください。ハルシネーションが深刻な場合、AI は「それっぽいドメイン名」を含む架空の URL を生成することもあります。

特に、以下の情報は厳格な確認が必要です。

- 統計データや数値

- 法律、条文、公的な制度

- 固有名詞(人名、会社名、製品名)

「人」による最終確認

AI は「論理的な整合性」はチェックできても、社会的背景や倫理的判断、自社の社風に合っているかといった人間特有の微妙なニュアンスの差を完全に理解することはできません。

たとえ情報が事実であっても、その言い回しが顧客に対して失礼ではないか、自社のブランドイメージを損なわないかといった観点での「人の目による確認作業」は、AI 活用の最終防衛ラインです。

より安全に業務活用するには、社内研修・社員教育が重要

ここまでは個人のスキルにまかせた対策に焦点を当ててきましたが、企業が組織として Gemini を導入する場合、個人に任せるだけでは限界があります。

一部の IT に強い社員だけが AI を使いこなせている状態では、組織全体のリスクは軽減されません。むしろ、リテラシーの低い社員がハルシネーションに気づかず業務事故を起こすリスクが高まります。

そこで重要なのが、「AI は間違えるものである」という前提を共有し、正しいプロンプトの書き方や検証フローを全社員が共通言語として持つための社内研修・社員教育です。これにより、AI による情報漏洩や誤情報の拡散、ブランドイメージの低下などのリスクを防ぐことができます。

生成 AI を「導入」で終わらせない! 5 つのステップで人材育成

組織全体で生成 AI 導入を成功させるポイントとは ?! 生成 AI を安全に使いこなせる「人」と「組織」づくりを解説。

▼Google Workspace および Gemini の導入・活用を支援についてご検討中でしたら、ぜひTS クラウドへご相談ください。

AI リテラシー向上こそが最強のハルシネーション対策

Gemini のハルシネーションは、技術の進歩とともに減少していくでしょう。しかし、AI が予測モデルである以上、そのリスクがゼロになる日はすぐには来ないかもしれません。

私たちが今すべきことは、AI を拒絶することでも、盲信することでもありません。ハルシネーションという「癖」を正しく理解し、プロンプトで制御し、人の目で確認するという、 AI との適切な付き合い方を習得すること です。

組織全体で AI リテラシーを向上させることは、 ハルシネーション を防ぐ「守り」の側面だけでなく、AI を最大限に活用し、圧倒的な生産性を獲得する「攻め」の戦略でもあります。

Google Workspace を導入し、強力なビジネスパートナー として Gemini を活用したいとお考えでしたら、まずは TSクラウドまでお気軽にご相談ください。